La nouvelle intelligence artificielle (IA) de Google ne peut plus générer d’êtres humains jusqu’à nouvel ordre, a annoncé l’entreprise. En cause, la création d’images historiques incohérentes, voire même problématiques.

Une nouvelle problématique

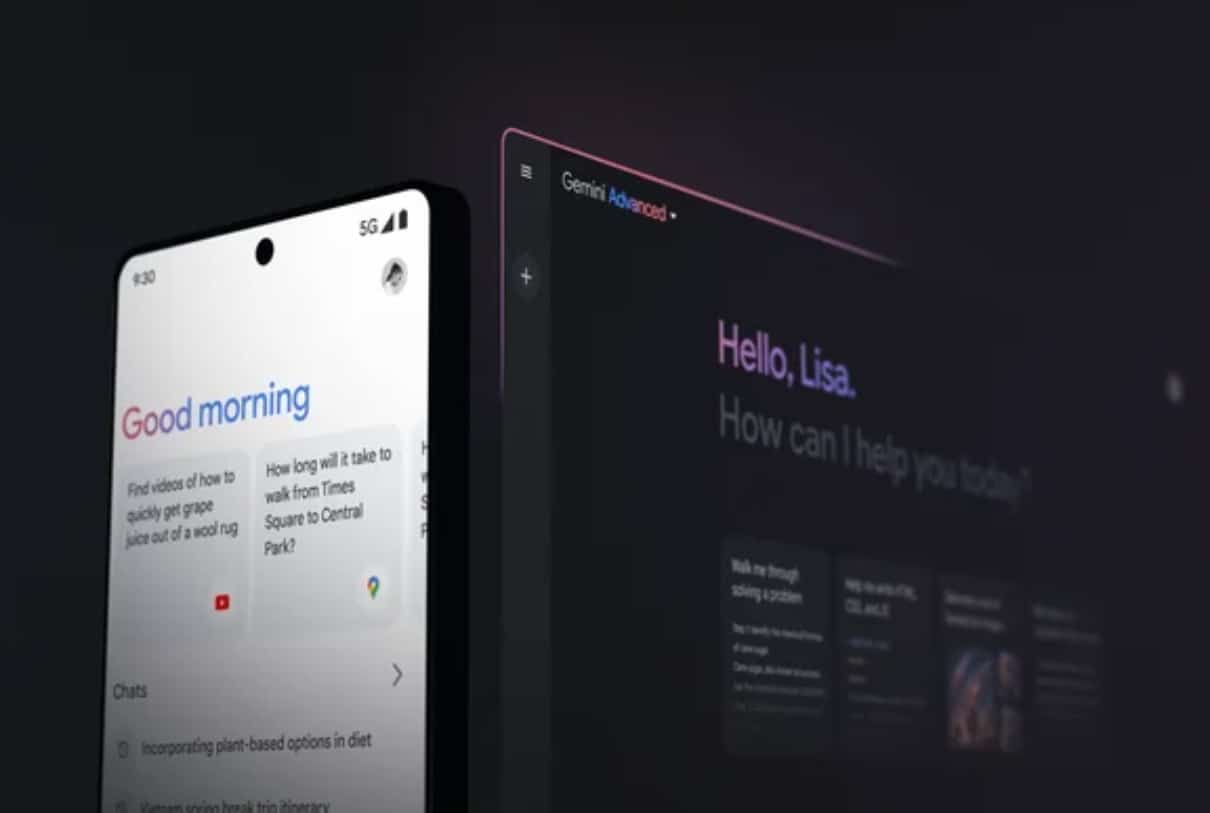

Google a lancé l’outil de génération d’images Gemini plus tôt ce mois-ci, en même temps que le déploiement de son offre payante pour accéder à la version la plus sophistiquée du modèle. Depuis plusieurs jours, de nombreux posts sur les réseaux sociaux se plaignent d’inexactitudes historiques dans ses créations. Par exemple, L’IA a généré des images de femmes et de personnes de couleur en tant que soldats allemands de la Seconde guerre mondiale, Pères fondateurs ou Vikings.

Inscrivez-vous à la newsletter

En vous inscrivant vous acceptez notre politique de protection des données personnelles.

La firme de Mountain View a rapidement reconnu son erreur, indiquant avoir « manqué le coche ». Dans un post sur X, elle explique « mettre en pause la génération d’images de personnes », en attendant de déployer une version améliorée de l’IA.

Depuis plusieurs années, des études démontrent que l’intelligence artificielle fait parfois preuve de biais racistes, sexistes et homophobes. Dans un souci de corriger cette partialité, Google a amplifié le phénomène inverse, engendrant une autre problématique. En générant des personnes noires ou amérindiennes en tant que fondatrices des États-Unis, par exemple, l’IA efface les centaines d’années d’oppression à l’égard de ces populations.

« Les contextes historiques sont plus nuancés et nous les adapterons en conséquence », a indiqué Jack Krawczyk, directeur principal du produit Gemini chez Google.

Les failles de l’IA générative

Cette déconvenue tombe mal pour la firme de Mountain View. Prise de court par les avancées d’OpenAI et de Microsoft dans le domaine de l’intelligence artificielle générative, la société a décuplé ses efforts en interne pour combler son retard.

Lors du lancement de son IA conversationnelle Bard l’année dernière, de nombreuses personnes ont critiqué l’entreprise. Ses employés ont même jugé l’annonce du modèle comme bâclée et précipitée. Le déploiement de Gemini marquait un nouveau tournant pour Google dans la course effrénée à l’IA générative.

Un incident qui rappelle également les failles de cette technologie malgré sa croissance exponentielle. L’une des principales caractéristiques des modèles d’IA générative est leur tendance à halluciner. Un problème que les fournisseurs d’IA s’efforcent de minimiser mais peinent, pour le moment, à vraiment contrôler.