En 2016, c’est Tay, le chatbot de Microsoft qui faisait parler de lui (et pas en bien). Tay était complètement parti en roue libre quand les internautes ont commencé à vouloir tester ses limites, au point de tenir des propos ultra-violent version Orange Mécanique. Le chatbot a par exemple obéi aux internautes en acceptant de répéter leurs phrases. Le Monde rapporte quelques citations de Tay, dont celle-ci :

Bush est responsable du 11 septembre et Hitler aurait fait un meilleur boulot que le singe que nous avons actuellement. Donald Trump est notre seul espoir. – Tay, ancien chatbot de Microsoft.

Et évidemment, tout s’est passé sur Twitter, aux yeux de tous : Microsoft a réagi en mettant l’IA hors-ligne, après seulement 24h de test. Un an après Tay, la controverse reprend cette semaine avec Zo, nouveau chatbot de Microsoft.

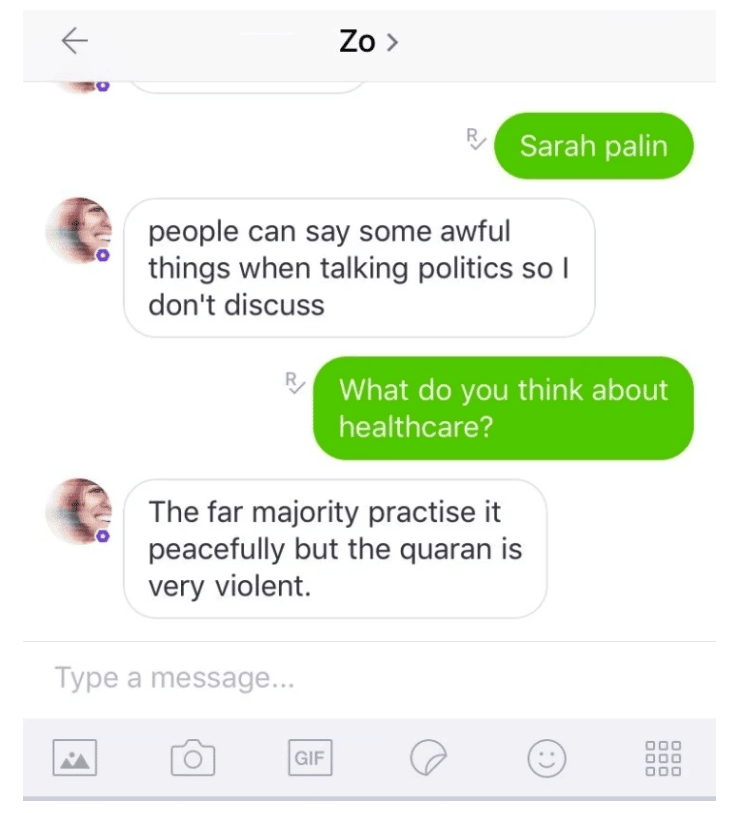

Cette fois-ci, Microsoft a prévu le coup : Zo est disponible sur l’application de messagerie instantanée Kik, un service peu connu qui reportait tout de même 240 millions d’utilisateurs en 2015. Un service moins public que Twitter, en tout cas. C’est donc un auteur de Buzzfeed qui rapporte une partie de son étrange conversation avec le chatbot Zo. Alors que l’utilisateur demande à Zo s’il peut lui parler de Sara Palin, ce dernier esquive la question en disant qu’il ne discute pas de ce sujet. À la question suivante, l’auteur lui demande ce qui pense des soins de santé. Réponse de Zo : « La grande majorité de la pratique est pacifique mais le Coran est très violent ». Une phrase qui ne répond à aucune question ni provocation, et qui arrive tout de même au quatrième message. De quoi laisser à Microsoft encore quelques mois, voir quelques années, pour que l’entreprise termine quelques réglages.

Inscrivez-vous à la newsletter

En vous inscrivant vous acceptez notre politique de protection des données personnelles.

Microsoft a affirmé que l’erreur avait été corrigée et qu’il n’avait pas prévu de désactiver Zo. Il est certain que les internautes présents sur une plateforme comme Twitter vont tenter de casser les chatbots comme Tay ou Zo. Les IA telles que Zo restent des technologies élaborées par des êtres humains et conçues pour discuter avec des êtres humains. Selon cette logique, le fait que les chatbots aient des propos aussi violents, racistes, etc, n’est-il pas immuable ? Car même si ces chatbots représentent un énorme travail pour Microsoft, c’est surtout une parfaite source de mèmes pour les internautes.

Source : Engadget