À l’heure actuelle, la plupart des modèles de traduction automatique sont des modèles bilingues nécessitant de nombreux exemples étiquetés dans chaque paire de langues. Pour contourner cela, Meta AI a développé un modèle multilingue qui peut ainsi traduire plusieurs langues à la fois.

Meta AI tente de relever le défi du modèle multilingue

L’objectif ultime du secteur de la traduction automatique est de construire un modèle de traduction universel utilisable par tous. Ainsi, tout le monde pourrait accéder à l’information et les possibilités de connexion entre les individus seraient démultipliées.

Inscrivez-vous à la newsletter

En vous inscrivant vous acceptez notre politique de protection des données personnelles.

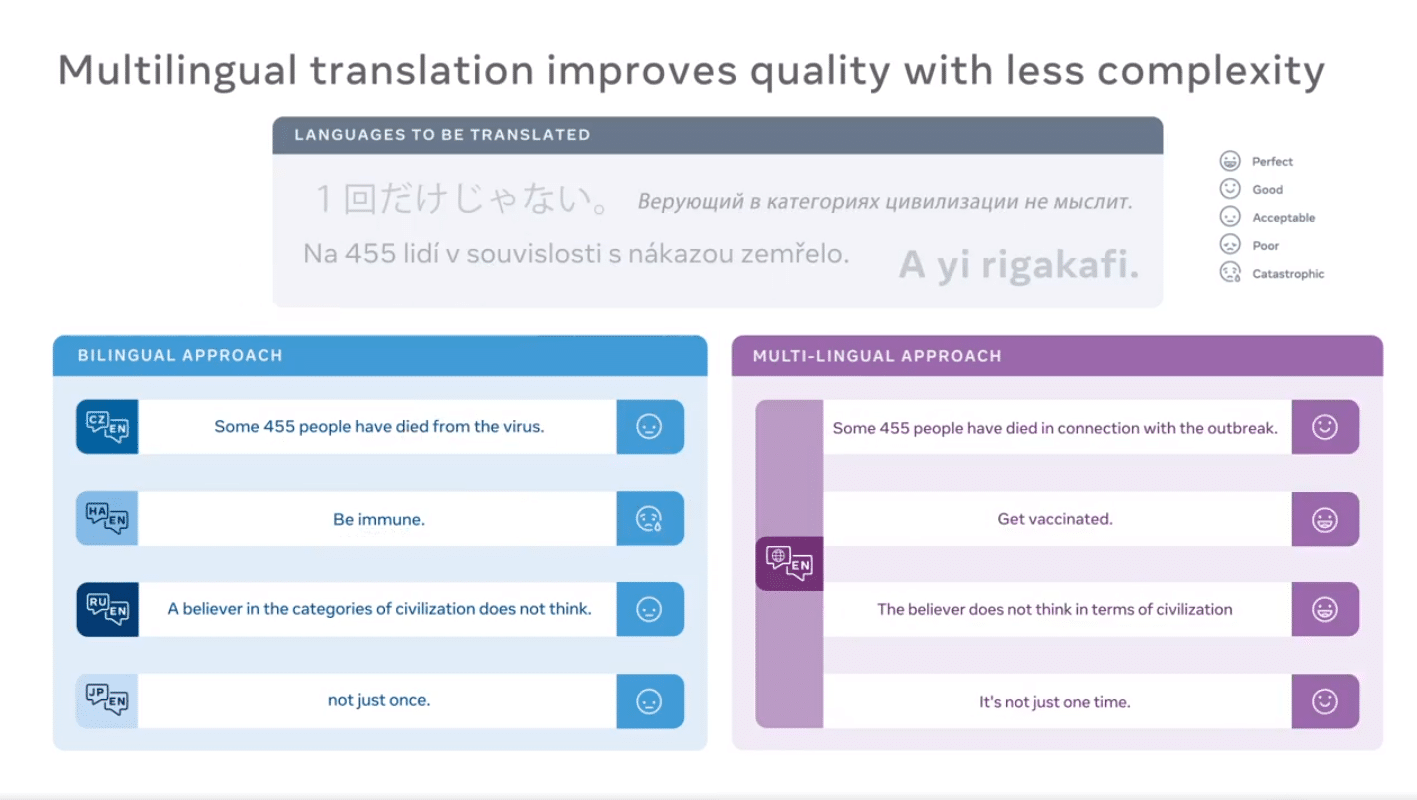

L’utilisation de l’approche multilingue permet d’avoir une traduction plus précise en fonction du contexte de la phrase. Capture d’écran : Meta AI.

Les précédents travaux de la branche IA de Meta ont permis d’améliorer la qualité des traductions vers des langues dites à « faibles ressources ». Contrairement aux langues à « grandes ressources » comme l’anglais, l’espagnol ou l’allemand, ces langues sont celles qui ne sont parlées que dans une certaine région du monde plus « restreinte » comme l’islandais.

C’est en partant de ce constat et de ses dernières recherches sur les langues à « faibles ressources » que Meta AI a tenté de concevoir son propre modèle multilingue. Toutefois, les travaux antérieurs montrent des problèmes lorsque plusieurs langues sont ajoutées à un modèle : il est alors submergé d’informations, car chaque langue possède des propriétés linguistiques uniques.

Deux systèmes multilingues en un pour contourner les problèmes des modèles bilingues

Afin de réussir à surmonter ce problème, les équipes de Meta ont mis au point deux systèmes multilingues : un intitulé « Anglais vers n’importe quelle langue », et l’autre « n’importe quelle langue vers l’anglais ». En tirant parti de ses modèles bilingues de traduction de l’anglais vers l’allemand, Meta a ajouté des données monolingues à grande échelle avec des centaines de millions de phrases dans huit langues préalablement choisies (anglais, tchèque, allemand, islandais, japonais, russe, chinois et haoussa).

Les données ont été filtrées afin de réduire les données parasites puis chacune d’entre elles a été traduite à nouveau à l’aide de son moteur multilingue le plus puissant jusqu’à présent : le M2M-100 qu’elle a conçu l’année dernière. Pour former son nouveau modèle multilingue, les chercheurs ont subdivisé le modèle en plusieurs sous-ensembles afin d’accélérer son entraînement. Meta a utilisé le GPU Fully Sharded Data Parallel qui lui a permis de former son modèle cinq fois plus rapidement qu’avec d’autres processeurs.

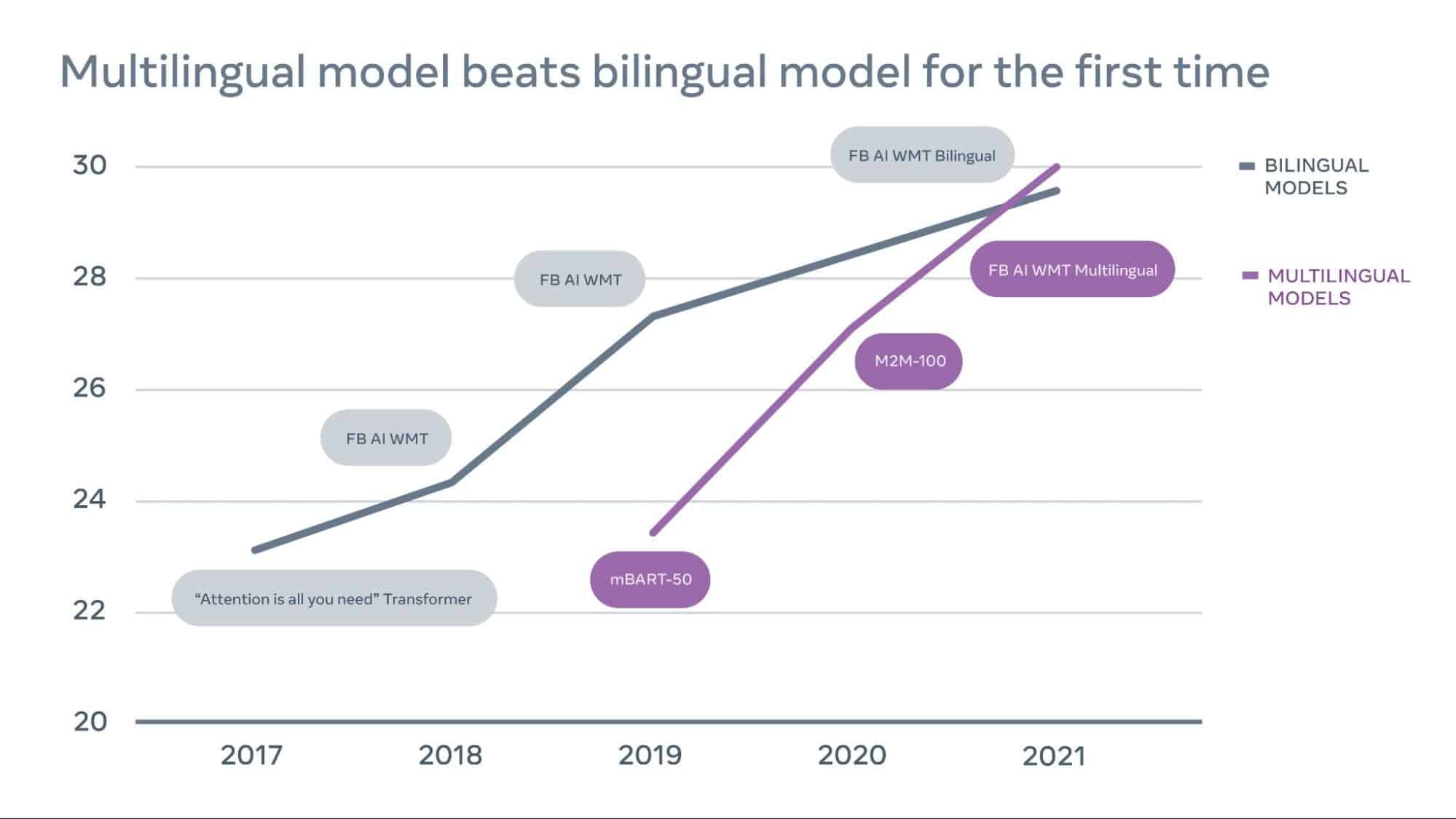

Entre 2018 et 2021, Meta AI a conçu plusieurs modèles de traduction automatique multilingue dans le but qu’ils soient plus performants que leurs modèles bilingues. Capture d’écran : Meta AI.

En 2018 et 2019, Meta avait remporté le WMT grâce à son modèle bilingue traduisant de l’anglais vers l’allemand. En utilisant sa nouvelle méthode de traduction automatique multilingue, Meta AI a réussi a remporté le WMT 2021 en surpassant les modèles bilingues qu’il avait déjà conçus.