En ligne, les enfants sont de plus en plus exposés aux dangers d’internet et donc aux images à caractère sexuel. Pour lutter contre cela, Apple a dévoilé le 5 août des outils ayant un but bien précis : repérer les contenus pédopornographiques. Ils seront effectifs lors des prochaines mises à jour des systèmes d’exploitation sur iPhone, iPad, Apple Watch, Mac, mais aussi iCloud. Pour le moment, cela ne concerne que les États-Unis.

Apple présente trois outils pour lutter contre la pédopornographie

Déjà en mai 2019, les géants de la Tech, dont Apple, contribuaient à une enquête sur les crimes pédophiles en ligne. Afin de poursuivre sur cette voie, l’entreprise déploie aujourd’hui trois nouvelles mesures.

Inscrivez-vous à la newsletter

En vous inscrivant vous acceptez notre politique de protection des données personnelles.

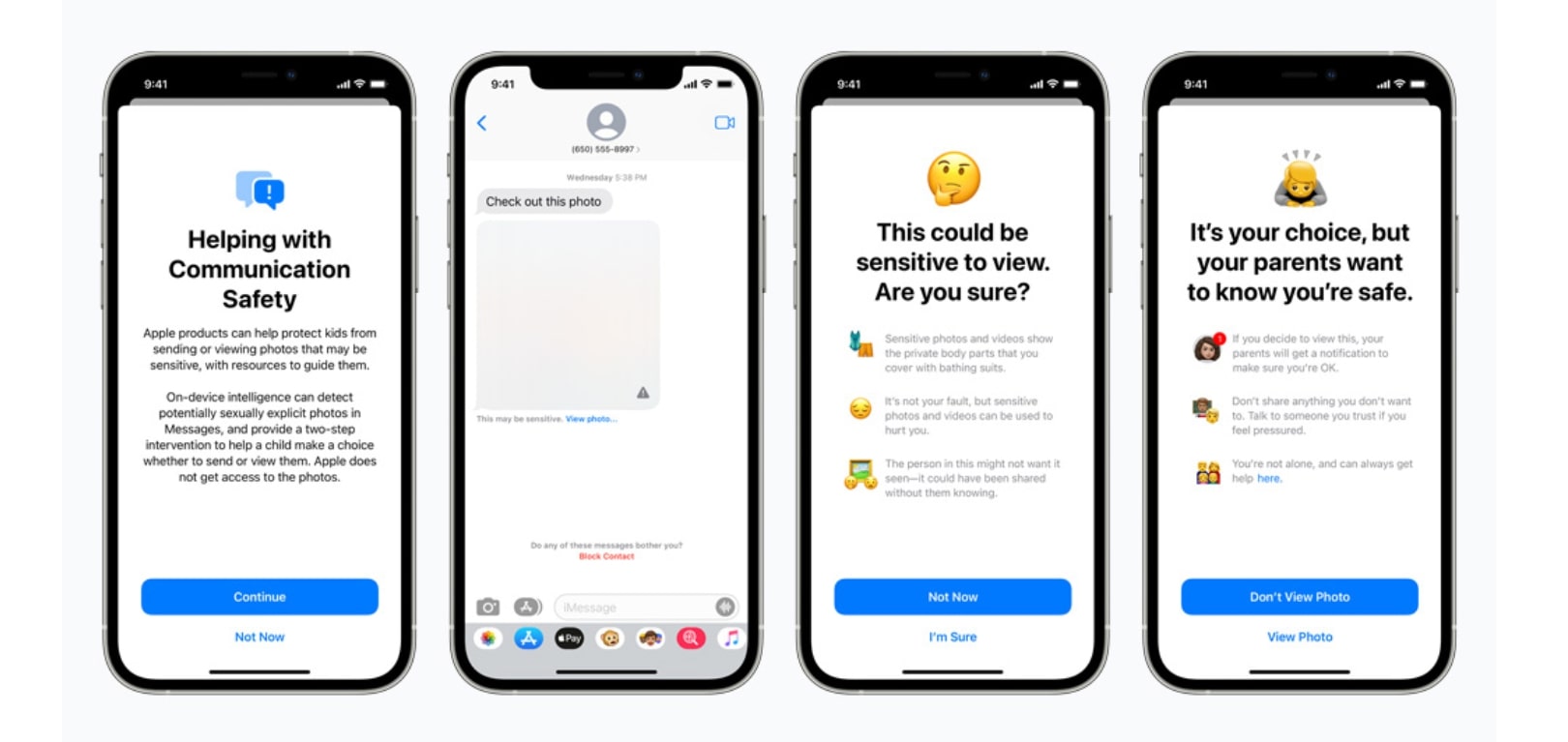

Protéger les enfants au sein de l’application Messages

La première concerne l’application Messages, qui se dotera des fonctionnalités permettant de prévenir l’enfant que le contenu qui lui est partagé est potentiellement sensible. Par cela sont sous-entendues des images sexuellement explicites envoyées par des prédateurs. Lorsque le jeune utilisateur recevra ce type de photos, elles seront systématiquement floutées. Sur son téléphone, une alerte lui expliquant les dangers du message qui vient de lui être envoyé apparaîtra.

Le nouvel outil présent dans Messages visera à protéger un enfant de ce qu’il reçoit. Image : Apple

Si le mineur décide malgré tout de voir le contenu, une notification pourra être transmise à ses parents s’ils ont activé cette fonctionnalité. Il en est de même lorsqu’il partage une photo à caractère sexuel. Néanmoins, cet outil ne sera disponible qu’aux familles possédant un compte iCloud commun.

Un outil de détection d’images pédophiles

Afin de lutter efficacement contre la pédocriminalité, Apple utilisera une technologie de détection d’images appelée NeuralHatch. Elle analysera le contenu présent dans la galerie photos. Elles seront alors comparées avec celles présentes dans un fichier détenu par le Centre national des enfants disparus et exploités (NCMEC), une organisation travaillant avec les forces de l’ordre américaines.

Si la similitude est assez élevée, la photo sera alors transmise à Apple, qui l’examinera. En cas de correspondance et de dépassement d’un certain seuil, elle sera envoyée aux autorités, sans prévenir l’utilisateur. L’entreprise garantit un niveau “extrêmement élevé” de vigilance pour que des comptes ne soient pas signalés et supprimés inutilement.

Siri deviendra également un allié de taille

Enfin, Siri et les fonctionnalités de recherche seront également utilisés dans ces nouvelles mesures de protection. Ils proposeront des liens rapportant des cas d’exploitation sexuelle de mineurs si l’utilisateur en demande. L’objectif semble plutôt pédagogique.

Le mineur aura accès à des ressources grâce à Siri et aux fonctionnalités de recherche. Image : Apple

Des nouveautés qui soulèvent de nombreuses questions

Bien que la firme indique ne pas avoir directement accès aux messages et aux images, ces affirmations ne convainquent pas tout le monde. Pour Greg Nojeim du Centre pour la démocratie et la technologie (CDT), “Apple remplace son système de messagerie crypté de bout en bout par une infrastructure de surveillance et de censure, qui sera vulnérable aux abus et aux dérives non seulement aux États-Unis, mais dans le monde entier”.

De nombreux utilisateurs craignent que ces outils soient utilisés abusivement et étendus à d’autres catégories de contenus jugés illicites. Certains d’entre eux redoutent également la surveillance de masse. Pour le CDT, ces changements “marquent une rupture significative par rapport aux protocoles de confidentialité et de sécurité établis de longue date”.