En 2018 une équipe de chercheur du MIT était parvenue, grâce aux signaux radio des fréquences WiFi, à apprendre à une intelligence artificielle à détecter une personne en mouvement derrière un mur ou plongée dans l’obscurité. Depuis, la technologie a évolué, et l’IA peut désormais identifier une action dissimulée.

La suite de travaux de 2018

La vision industrielle, c’est-à-dire la vision par ordinateur dans les domaines de l’industrie et de la recherche, ne cesse de s’améliorer. Des ordinateurs peuvent maintenant reconnaître des visages, des actions, ou encore des objets. Cependant ces systèmes ont les mêmes limites que l’œil humain : ils ont une perception basée sur la lumière. Aussi performants soient-ils, ils sont aveugles lorsqu’une action est occultée ou plongée dans l’obscurité.

Inscrivez-vous à la newsletter

En vous inscrivant vous acceptez notre politique de protection des données personnelles.

Pour remédier à cela, des chercheurs du laboratoire de recherche en informatique et intelligence artificielle (CSAIL) du MIT ont eu une idée. Apprendre à une IA à voir grâce aux signaux radio. Les ondes radio ont deux avantages : la luminosité ne les influence pas, elle se propage faisant fi des cloisons.

Dès 2009 des scientifiques de l’Université de l’Utah étaient parvenus, grâce aux ondes d’un réseau sans fil, à voir au travers d’une porte. La résolution est très faible, pour un œil non averti difficile de comprendre grand-chose, mais le résultat est là. En 2017 des membres de l’Université Technique de Munich étaient parvenus a cartographier une pièce grâce au signal émis par un routeur WiFi.

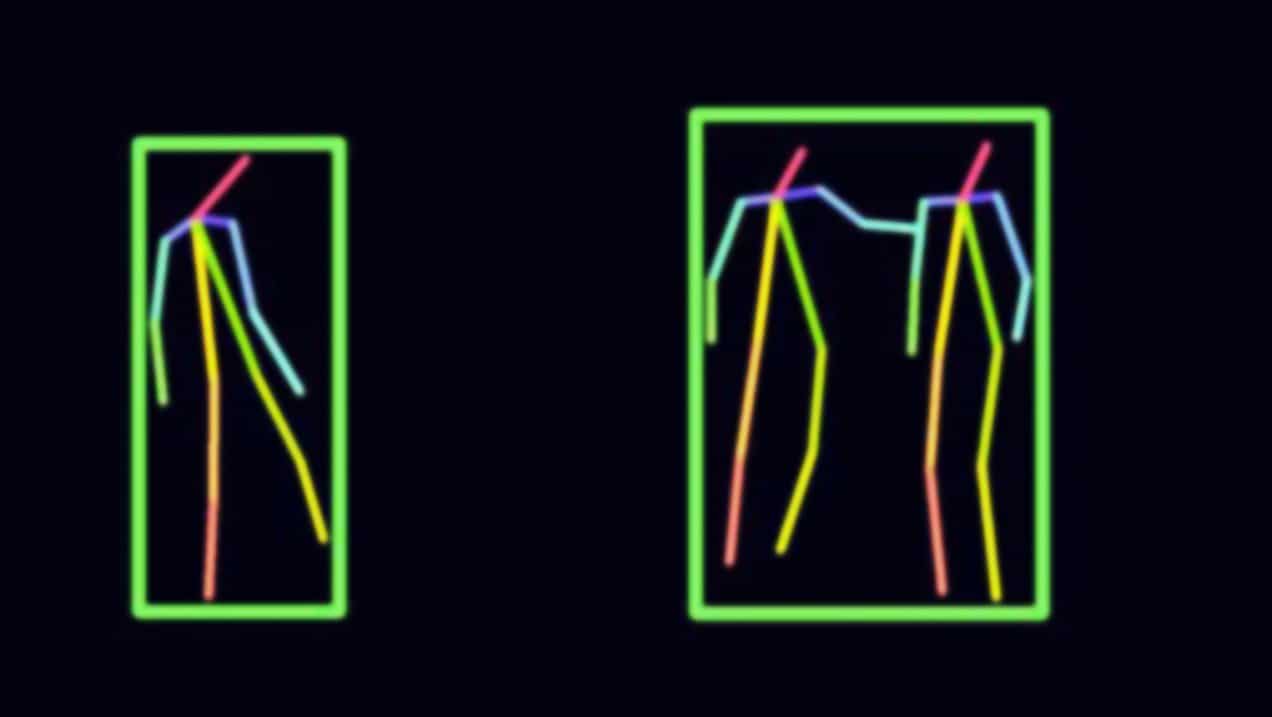

En 2018, l’équipe du MIT a réussi à créer une solution du nom de RF-Pose. Cette IA est capable d’identifier une personne derrière un mur, mais aussi de déterminer si la personne en question bouge les bras ou les jambes grâce à une modélisation d’un squelette 2D.

Le 9 octobre le CSAIL a donné de ses nouvelles. Le chercheur Tianhong Li, ancien membre de l’équipe de 2018, et ses collègues, ont présenté un nouveau système nommé RF-Action. « Nous introduisons un modèle de réseau neuronal capable de détecter des actions humaines à travers les murs et les occlusions, et dans de mauvaises conditions d’éclairage », explique-t-il.

L’IA a ingurgité 25 heures de vidéos pour apprendre à identifier des actions

Les chercheurs ont appris à leur intelligence artificielle à identifier des actions bien précises : serrer la main, être au téléphone… Le tout à partir de radiofréquences. Pour parvenir à ce résultat 35 actions, 29 individuelles, 6 en interaction, réalisées par 30 volontaires, dans 10 espaces différents, couloir, bibliothèque, salle d’attente, ont été scrutées par la machine pendant 25 heures.

L’IA a accumulé des données simultanément avec les ondes et avec la lumière. « En traduisant les données d’entrée avec une représentation intermédiaire basée sur un squelette, notre modèle peut apprendre des deux sources de données, la vue et les radiofréquences pour permettre aux deux tâches de s’entraider », développe Li et son équipe.

Les chercheurs estiment que leur IA parvient aussi bien à identifier des actions dans la pénombre ou derrière un mur que les autres systèmes de vision industrielle se servant de la luminosité. Il convient toutefois de préciser que RF-Action n’a été testée qu’à travers un seul mur et à une distance de 1 à 11 mètres.

La performance reste remarquable. Tianhong Li imagine déjà les applications de sa technologie. Une maison intelligente pourra, par exemple, repérer, en toute circonstance, et à toute heure, si une personne âgée s’est blessée chez elle en chutant.

Malheureusement ce n’est pas des applications aussi pures qui viennent en tête. Cela évoque plutôt 1984 ou les systèmes de vision de la Chine pour surveiller sa population. L’idée dérangeante qu’un gouvernement ou une personne mal intentionnée pourront observer des personnes au sein de leur propre domicile.

Tianhong Li estime, lui, au contraire, que cette technologie est plus respectueuse de la vie privée, la résolution des ondes étant trop faible pour identifier une personne. À suivre attentivement les progrès de cette nouvelle technologie et surtout comment elle sera utilisée.