Dans un rapport assez complet, le New York Times nous révèle les secrets « des règles de modération » chez Facebook. Le média a pu avoir accès à un document de plus de 1 000 pages et ce qui en ressort est sans surprise assez décevant.

De nombreuses informations sont obsolètes, les traductions des règles en langues étrangères se font via Google Traduction et ne prennent pas en compte les différences culturelles et bien d’autres points spécifiques, comme la situation politique de certains pays.

Plus tôt cette année, nous vous présentions les conditions de travail de ces modérateurs qui examinent environ 8000 publications par jour. Parmi ces dernières on retrouve de la pornographie, des fakes news et bien évidemment du contenu violent ou offensant auquel il faut être prêt à faire face au quotidien.

À travers le guide fournit aux modérateurs, Facebook tente d’être clair sur ce que les utilisateurs ont le droit ou non de dire. Pour les modérateurs le travail est plus complexe et ils sont souvent frustrés du manque de temps et du manque de recul face au contexte de la publication.

Une réunion hebdomadaire pour discuter des règles

On apprend ainsi que les règles sont discutées chaque mardi lors de réunions. Elles sont ensuite envoyées à travers des PowerPoint aux 7000 modérateurs dans le monde entier.

Le problème avec ces dernières est qu’elles sont définies par des personnes n’ayant aucun rapport avec les pays pour lesquels elles sont définies. Une règle pour le Royaume-Uni ne sera pas forcément la même pour l’Inde et le problème de la langue pose problème. Les règles sont retranscrites dans la langue du pays via une traduction approximative qui ne prend pas en compte les contextes locaux.

Un exemple concret est donné : « des appels à la collecte de fonds pour les victimes de l’éruption d’un volcan en Indonésie ont été supprimés, car un co-sponsor de la campagne figurait sur la liste interne des groupes interdits de Facebook. »

Un manque de recul face au contexte des publications

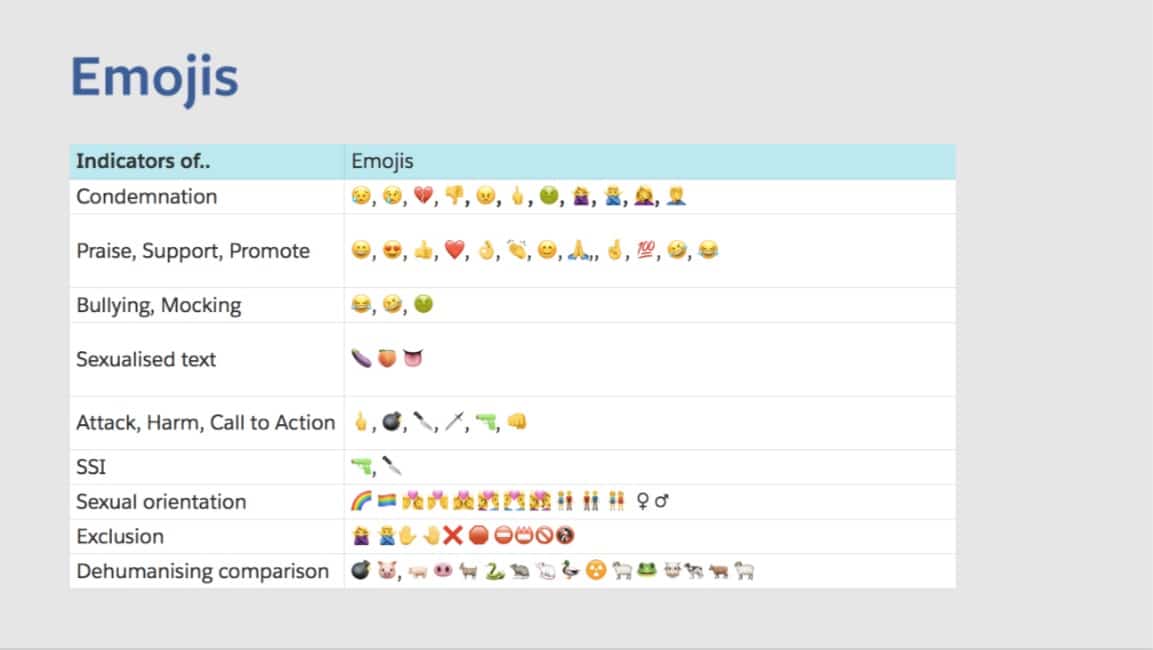

Pour les emojis, Facebook a créé un tableau supposant la signification de certains d’entre eux comme on peut le voir ci-dessous. Ainsi l’utilisation de l’emoji qui pleure de rire, peut dans un certain contexte être considéré comme du harcèlement. La question est dans quel contexte ? Comment en à peine dix secondes l’utilisation de cet emoji peut être considéré comme tel ? Notamment lorsque le texte est écrit dans une langue qu’ils ne savent pas lire…

Dans sa modération, Facebook devient en quelque sorte juge des questions politiques du monde entier et parfois même d’une manière complètement maladroite. La société a d’ailleurs été accusée à plusieurs reprises de protéger les pages d’extrême droite.

Inscrivez-vous à la newsletter

En vous inscrivant vous acceptez notre politique de protection des données personnelles.

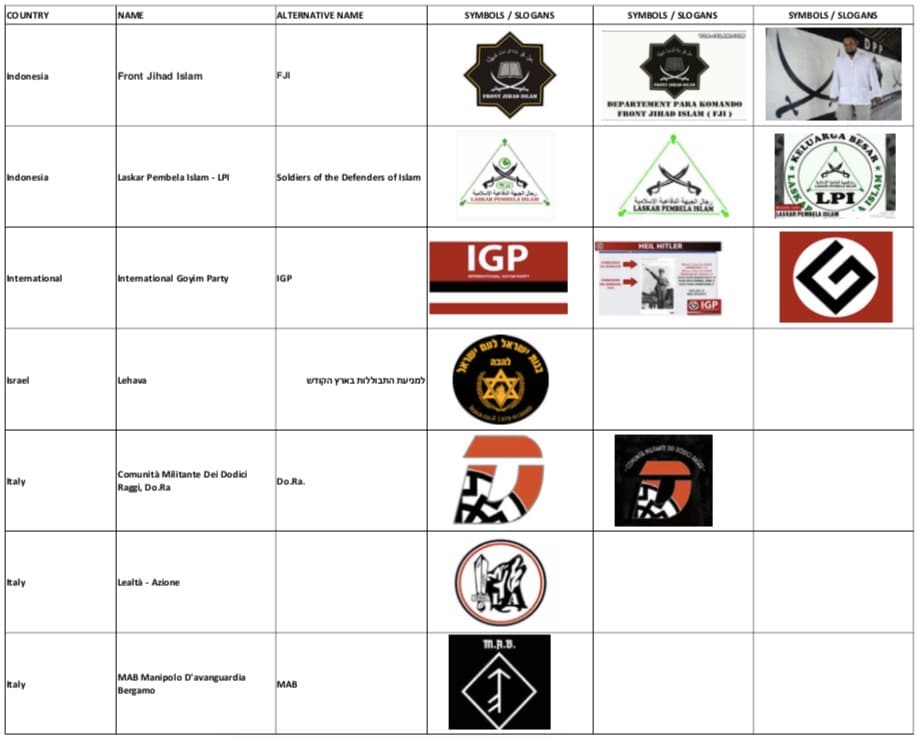

Un autre document intéressant fournit aux modérateurs est la « hate list » qui regroupe les noms des groupes ou individus que l’entreprise juge comme figure de haine, comme on peut le voir ci-dessous.

Les utilisateurs n’ont ainsi pas le droit de publier du contenu qui vante leur mérite et les modérateurs ont l’obligation de supprimer les contenus les représentant ou les encourageant. Un expert des groupes d’extrême droite, Anton Shekhovtsov, confie être « confus quant à la méthodologie. » Dans les pays où l’extrême droite est violente, comme la Russie ou l’Ukraine, très peu de groupes sont interdits. La raison à cela ? Il semblerait que Facebook soit plus vigilant dans les pays pouvant exercer une certaine pression sur la société, comme par exemple l’Allemagne. Lorsqu’on parle de pression, il est évidemment question d’amende. La société tente également de se faire discrète dans les pays où elle vient d’arriver afin d’éviter « un incendie de relations publiques » pour éviter « tout ce qui pourrait nuire à la réputation de Facebook. »

Une sous-traitance qui pose problème

Vu les besoins de la société pour la modération, l’entreprise ne peut recruter des centaines de modérateurs. Pour faire le travail, Facebook fait appel à des modérateurs dans des sociétés externes. Malgré la transmission des règles, le réseau social de Mark Zuckerberg n’a que très peu de visibilité sur les conditions de travail des employés. C’est d’ailleurs pour ces conditions assez compliquées que les modérateurs ne restent pas plus de quelques mois à ce poste.

Avec ses règles, Facebook se positionne comme un acteur mondial dans le dialogue des individus et dispose ainsi d’un contrôle complet sur ce qui est dit. Le problème étant que ce n’est pas le rôle d’un réseau social et que malgré tout Facebook est dépassé par son influence et se transforme en régulateur politique du monde avec un pouvoir indétrônable.