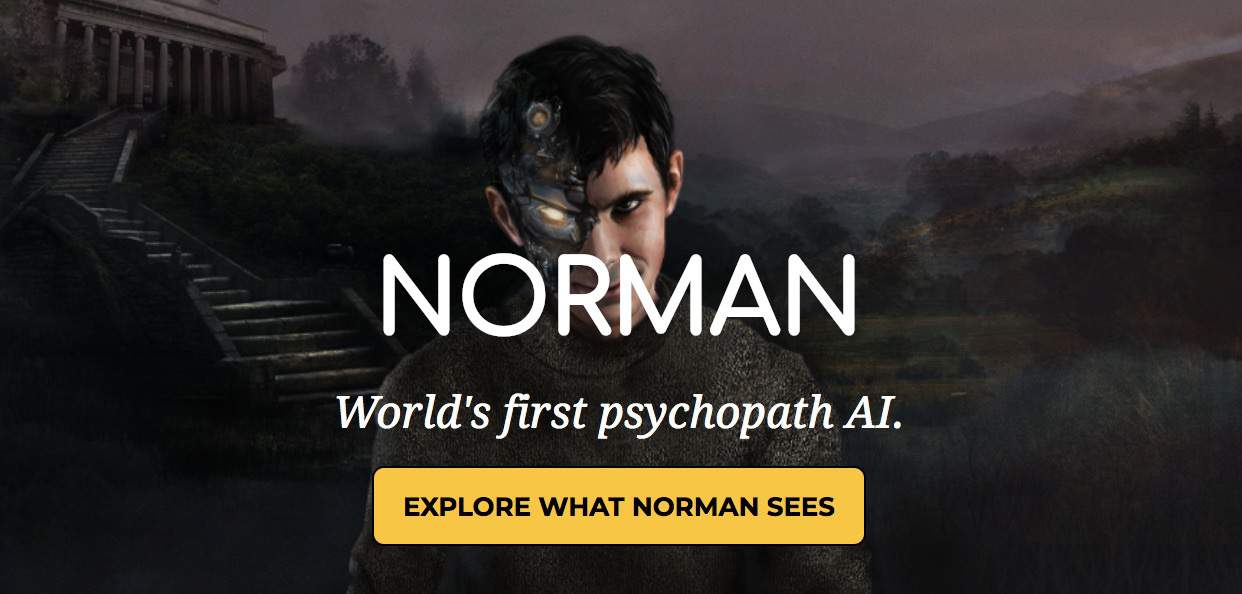

Des chercheurs du MIT ont décidé de s’intéresser aux dangers de l’IA. Pour cela ils ont formé la première IA psychopathe grâce à des légendes d’images assez sombres sur la mort, trouvées sur Reddit : Norman, dont le nom s’inspire de Norman Bates dans Psychose.

Lorsque la perception de Norman est comparée à celle d’un réseau de neurones de sous-titrage dit « normal », les résultats peuvent être assez choquantes. Les deux IA ont dû décrire ce qu’elles percevaient sur les tâches d’encre de Rorschach, que les psychologues utilisent pour décrire et évaluer l’état d’esprit d’un humain.

Inscrivez-vous à la newsletter

En vous inscrivant vous acceptez notre politique de protection des données personnelles.

Sur l’image ci-dessus, l’IA « normale » va décrire des oiseaux assis au sommet d’un arbre et Norman … quelqu’un qui se fait électrocuter. Autre exemple, sur l’image ci-dessous, on pourrait naturellement observer un vase avec des fleurs, mais non Norman voit un homme se faire abattre.

Les autres comparaisons sont disponibles sur le site dédié à Norman. Comme Norman a été entrainé sur des images décrivant la mort, il est normal que sa perception soit plus sombre. L’objectif avec Norman est d’illustrer les problèmes généraux liés à l’IA et les données biaisées. Les systèmes de neurones sont souvent entraînés à partir de nombreuses données, qui peuvent parfois s’avérer biaisées, ce qui amène logiquement de mauvais résultats.

L’équipe de chercheurs du MIT, travaille également sur un autre projet pour « lutter contre les préjugés et la discrimination basés sur le machine learning. » Vous pouvez aider Norman à aller mieux. Un questionnaire a été publié, afin d’avoir vos descriptions des diverses images que Norman a dû décrire. Plus de 200 000 réponses d’utilisateurs ont déjà été récoltées.

L’IA est en général utilisée pour développer des choses utiles comme permettre le changement d’arrière-plan dans des vidéos ou bien diagnostiquer un arrêt cardiaque. Mais dans certains cas l’IA peut-être formée pour une utilisation liée aux armées ou au gouvernement, qui sans cadre réellement éthique peut être très controversée, comme la collaboration de Google avec le Pentagone.