Les plateformes sociales ont été très largement critiquées pour leur manque d’action dans la lutte contre le terrorisme. Suite à la pression des gouvernements politiques de différents pays, elles ne peuvent faire autrement que de prendre des mesures et de participer à cette lutte. En juin, Facebook, Microsoft, Twitter et Youtube ont formé le Forum d’Internet Mondial, un forum où chacune des entreprises participantes cherchent des solutions technologiques pour détecter des contenus extrémistes. Récemment, Facebook a participé à une réunion qui regroupait des dirigeants politiques ainsi que des dirigeants de plateformes telles que Facebook, Google ou Microsoft. Lors de cette réunion, le réseau social de Zuckerberg a admis devoir en faire plus pour la lutte contre le terrorisme.

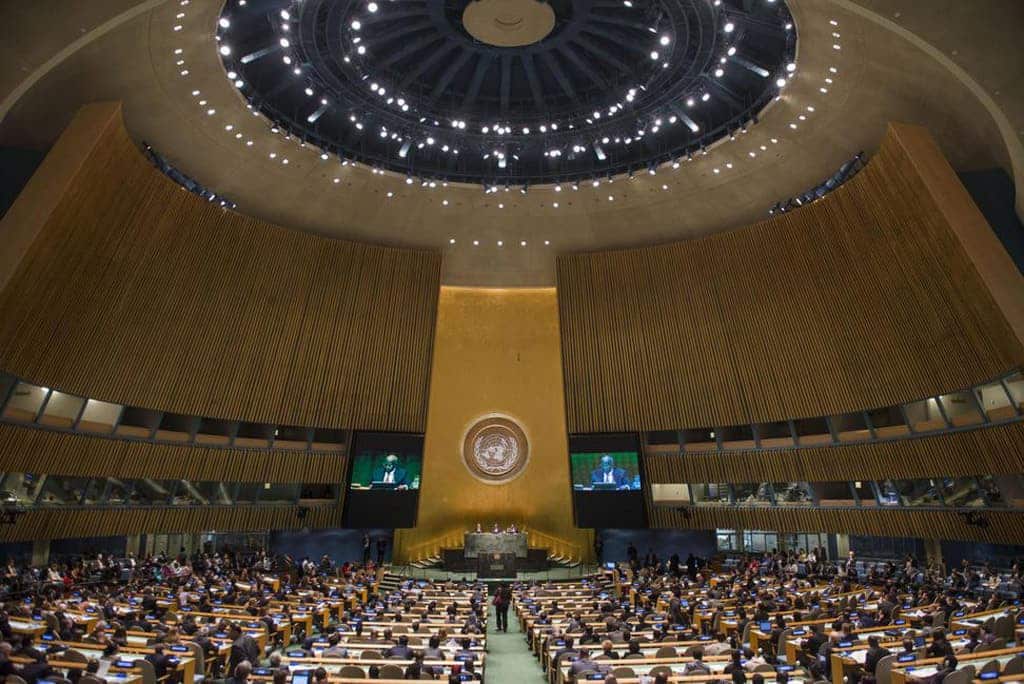

À l’Assemblée générale des Nations Unies de New-York, le réseau social a néanmoins préciser qu’il employait un staff de 150 personnes uniquement chargées de lutter contre le terrorisme. Malgré le fait que le réseau social travaille à une IA capable de repérer les images, vidéos ou posts à tendance terroriste, la surveillance humaine est encore nécessaire au bon fonctionnement de la manoeuvre. Pour le moment, l’intelligence artificielle peut repérer des insignes ou des drapeaux terroriste, mais a du mal à interpréter l’intention d’une affiche, selon Monika Bickert, Directrice de la gestion de la politique mondiale de Facebook.

Inscrivez-vous à la newsletter

En vous inscrivant vous acceptez notre politique de protection des données personnelles.

En plus de la première ministre britannique Theresa May, d’autres responsables politiques tels qu’Emmanuel Macron ou Paolo Gentiloni (premier ministre italien) ont enjoint Facebook à « aller de plus en plus vite pour automatiser la détection et la suppression du contenu terroriste en ligne ». C’est en tout cas l’avis tranché de Theresa May, qui souhaite que Facebook soit capable de supprimer une publication extrémiste deux heures après sa mise en ligne. Un objectif que Facebook n’a pas souhaité commenter, mais qui pourrait être atteignable selon Robert Blackie, consultant en stratégie numérique basé à Londres.

Jim Killock, le directeur d’Open Rights Group, une campagne souhaitant protéger vie privée et liberté d’expression sur le web, a souhaité mettre en garde contre les limites de ces processus automatisés. Selon ce dernier, des erreurs de suppression de contenu pourraient être réalisées.

Pourtant, malgré le fait que Facebook ait les deux pieds dans la lutte contre le terrorisme, le problème pourrait être la mouvance des extrémistes vers une autre plateforme. Ce qui, malgré la suppression de contenu sensible, ne calmerait pas leur propagation, qui aurait lieu ailleurs.

Sur Telegram par exemple.

Source : The Guardian